Imaginez un monde où le dialogue entre humains et animaux non humains est possible ー un futur où nous pourrions comprendre les baleines. Longtemps considérée comme relevant de la science-fiction, la communication des baleines s’est transformée en un milieu de recherche florissant. Avec l’arrivée de l’intelligence artificielle, des équipes de recherche partout à travers le monde plongent dans l’univers sonore mythique des cétacés pour déceler les schémas cachés de leur langage.

Une interaction unique en son genre

Le 12 décembre 2023, au sud-est de l’Alaska, a eu lieu un échange historique entre des scientifiques de l’équipe de Whale-Seti et un rorqual à bosse adulte de 40 ans, surnommé Twain. L’équipe de recherche avait émis une multitude de sons cette journée-là, par un haut-parleur sous-marin, sans recevoir de réponse.

Lorsque l’équipe joue un enregistrement d’un appel de contact capté la vieille dans cette même population, elle est alors témoin d’un événement hors du commun : une baleine semble lui répondre! Twain aurait quitté son groupe, elle se serait approchée du bateau et aurait tourné autour – entamant une sorte d’échange. Pour maintenir son attention, les chercheurs et chercheuses se seraient adapté·e·s à ses périodes de latence. Autrement dit, si la baleine prenait 10 secondes à répondre, l’équipe allait faire de même. L’échange aurait duré 20 minutes, durant lesquelles la baleine aurait participé verbalement et physiquement à trois phases d’interactions.

L’équipe de Whale-Seti, composée de membres de l’institut de SETI et de l’Alaska Whale Foundation, étudie les systèmes de communication des rorquals à bosse pour développer des filtres de reconnaissance pour la recherche d’intelligence extraterrestre. L’équipe suppose que la communication des baleines révèle un sens complexe – une intelligence se rapprochant du langage humain. Avec l’aide de l’intelligence artificielle, l’équipe de Whale-Seti souhaite mesurer la complexité de la communication des rorquals à bosse et comprendre les règles et les structures de leurs messages.

Projet CETI

À plus de 8000 km de là, basée sur l’île de la Dominique, se trouve une équipe multidisciplinaire dédiée à l’écoute et la traduction des vocalises de cachalots à l’aide de l’apprentissage automatique avancé et à la robotique.

En analysant un ensemble de données accumulées sur plus de dix ans et portant sur près de 9000 codas du clan des cachalots des Caraïbes orientales, l’équipe du Projet CETI a découvert, en 2024, que les cachalots ont possiblement un alphabet phonétique. Ces baleines à dents communiquent avec des codas ー de courtes rafales de clics entrecoupées de silences variables. Les séries de clics peuvent être combinées pour former des séquences complexes semblables à du morse.

L’étude illustre que leurs codas forment un système de communication mélangeant le rubato et l’ornement avec le rythme et le tempo. Autrement dit, leurs séquences de clics vont posséder un schéma de base qui ne change pas, représentant le rythme et le tempo. Ceux-ci vont être modifiés avec l’ajout de clics, qu’on appelle l’ornement, et la variation légère du temps entre les clics, qu’on appelle le rubato. « Bien que la fonction communicative de nombreux codas reste inconnue, ces résultats montrent que le système de communication du cachalot peut représenter un large espace de significations possibles », a déclaré la Dre Daniela Rus par l’entremise du site web de CETI, directrice du laboratoire d’informatique et d’intelligence artificielle du MIT et membre des équipes d’apprentissage automatique et de robotique du CETI. En d’autres termes, même si le sens des codas reste incompris, les possibilités de significations sont vastes.

Une recherche décisive à venir

Non loin de là, au large des Bahamas, le Wild Dolphin Project (WPD) mène le plus long projet sous-marin sur les dauphins dans une approche non invasive au monde. L’équipe étudie la communauté de dauphins tachetés de l’Atlantique dans leur milieu naturel. L’un de ses objectifs est d’observer et analyser la communication et les interactions pour établir les liens entre le son et des comportements spécifiques. Les scientifiques espèrent ainsi comprendre la structure et la signification potentielle de ces séquences sonores. Un travail colossal qui sera soutenu par l’arrivée de l’intelligence artificielle.

Le WDP commence cette saison de terrain à déployer Dolphin Gemma. Il s’agit d’un modèle d’IA fondamental ー fonctionnant par entrée et sortie audio ー développé par Google et formé majoritairement sur la base de données acoustiques des dauphins tachetés de l’Atlantique du WDP. Un modèle fondamental est un large modèle entrainé sur d’immenses ensembles de données, qui sert ensuite de base pour accomplir différentes tâches spécialisées. Dans le cas du fonctionnement par entrée et sortie audio, le modèle reçoit directement des vocalisations comme données d’entrée et génère en sortie de nouvelles séquences sonores, plutôt que du texte ou des images. Ce modèle vise à appréhender la structure des vocalisations. En s’appuyant sur des mécanismes de prédiction similaires à ceux des modèles de langage humain, il anticipe les séquences sonores suivantes et génère de nouveaux sons similaires. Ainsi, l’outil aidera les scientifiques à voir les motifs sonores récurrents et potentiellement découvrir des structures et des significations potentielles dans la communication naturelle des dauphins.

Une causette avec des dauphins

WPD poursuit aussi un projet d’interaction bidirectionnelle entre les dauphins et les humains afin de développer un vocabulaire commun à l’aide d’un ordinateur sous-marin conçu en partenariat avec l’institut de technologie de Géorgie, appelé CHAT (Cetacean Hearing and Telemetry). L’objectif est de créer une association de nouveaux sifflements artificiels hors du répertoire naturel, créés par CHAT, à des objets appréciés par les dauphins, comme les sargasses, des algues qu’ils utilisent pour le jeu. L’équipe de recherche espère que les dauphins, naturellement curieux, apprennent à imiter ces sifflements pour réclamer ces objets. L’objectif de cette technologie est d’explorer le potentiel d’interactions bilatérales, de mieux comprendre la communication des dauphins et de créer des référents linguistiques communs.

Pour permettre cette discussion, l’ordinateur CHAT est porté par les plongeurs et les plongeuses. Celui-ci reçoit les sons via deux hydrophones et les reproduit grâce à un haut-parleur sous-marin. Il possède en banque un ensemble de sons synthétiques qu’il sait reconnaître. Lorsque l’ordinateur émet un sifflement déclenché par un ou une plongeuse, il traduit également son sens à leur oreille. De même, lorsque l’ordinateur reconnaît l’un des sifflements artificiels reproduits par un dauphin, il le traduit directement à l’oreille du ou de la plongeuse. Ainsi, lorsqu’un dauphin s’exprime avec un sifflement présent dans la banque de sons conçus par CHAT, les chercheurs et chercheuses pourront comprendre et répondre rapidement en lui proposant le bon objet afin de renforcer l’association. Par exemple, si l’ordinateur reconnait le sifflement associé à la sargasse, l’algue utilisée pour le jeu, il le transmettra au plongeur ou à la plongeuse, qui montrera alors l’objet au dauphin.

Implications éthiques et juridiques

Comprendre les baleines grâce aux technologies de communication animale non humaine (NACT) pourrait chambouler notre rapport au vivant. La traduction de leur communication pourrait éveiller la curiosité et l’empathie envers les cétacésー et d’autres animaux. Elle pourrait prévenir les dommages causés par les activités humaines et elle permettrait de mieux cerner les mesures de protection en comprenant davantage l’impact de nos sociétés sur leurs vies. Elle pourrait appuyer et donner davantage de poids aux luttes juridiques pour la cause animale en fournissant des preuves concrètes de leur sentience, autrement dit la capacité d’un être vivant à ressentir des émotions, à percevoir son environnement et à éprouver des sensations subjectives comme la douleur et le plaisir.

Ces technologies ne restent pourtant pas sans risques et ne garantissent pas un monde meilleur pour le vivant. Alors que ces avancées attirent l’attention et les financements de tous bords, ces risques peuvent être aggravés avec la pression exercée par des acteurs extérieurs et la monétisation des données.

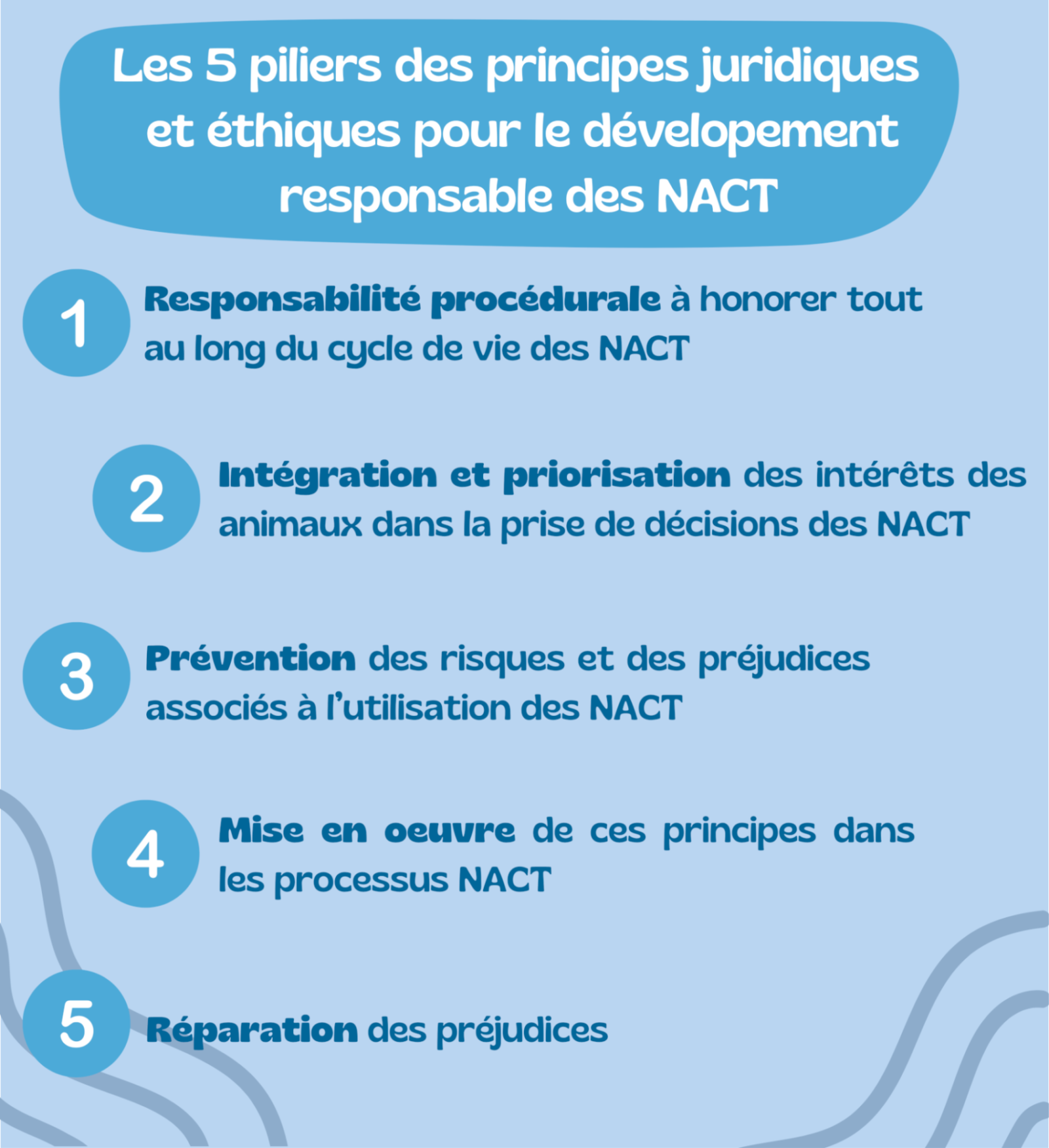

À l’heure actuelle, aucune loi ne régit les technologies de communication des animaux non humains hormis les comités institutionnels de protection et d’utilisation des animaux. Le programme «More-Than-Human-Life» (MOTH) de la faculté de droit de l’Université de New York a voulu combler ce manque en entreprenant un projet de recherche pour aboutir à un ensemble de principes juridiques et éthiques sur le développement responsable de ces technologies. Ceux-ci reposent sur un socle de valeurs fondamentales stipulant que les animaux non humains sont des sujets et non des objets. Ces technologies doivent être utilisées pour créer un lien de parenté avec le vivant et non un outil de domination sur lui. Ces principes procèdent selon cinq piliers. Ce rapport sera publié sous peu et ouvert à l’approbation et à l’adaptation des acteurs et actrices de ces technologies dans l’espoir de minimiser les risques de ces technologies et créer un monde où les baleines ー et les autres animaux non humains ー portent une voix. Espérons que nous aurons la sensibilité et la bienveillance pour tendre l’oreille.